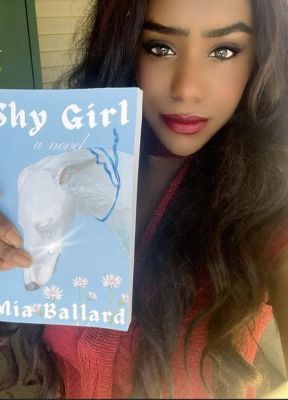

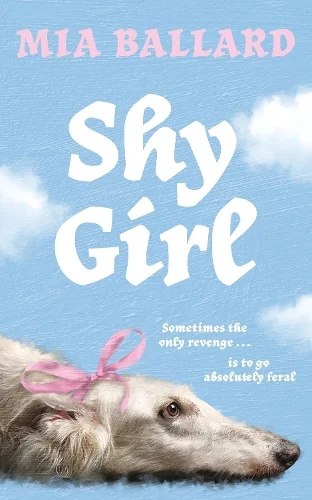

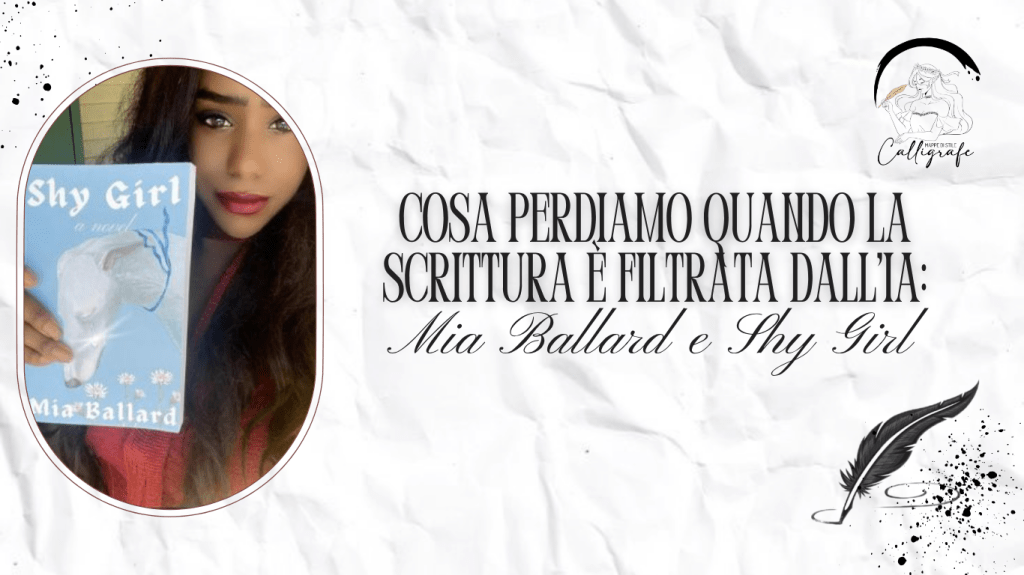

Nel 2025, un romanzo horror autopubblicato comincia a circolare su TikTok e nelle nicchie della community online. Si intitola Shy Girl ed è scritto da Mia Ballard, autrice che aveva all’attivo altri libri sempre pubblicati in self.

Il libro trova lentamente il suo pubblico tra recensioni entusiaste, passaparola e migliaia di valutazioni su Goodreads. Non è un successo costruito a tavolino, è uno di quei rari casi in cui un testo cresce dal basso, soprattutto sostenuto dai suoi primi lettori.

In rete si può ancora trovare un’intervista avvenuta il 25 agosto su Bookstr, a cura di Olivia Ackers, proprio a una entusiasta Mia Ballard: https://bookstr.com/article/mia-ballard-on-her-horrific-feminine-rage-novel

A un certo punto, però, accade ciò che ogni autore indipendente sogna: una grande casa editrice se ne accorge. Hachette, uno dei principali gruppi editoriali al mondo, acquisisce i diritti del romanzo. Gli assegna un editor, pianifica una nuova uscita internazionale, costruisce una campagna marketing: Shy Girl passa da scommessa personale a prodotto editoriale globale.

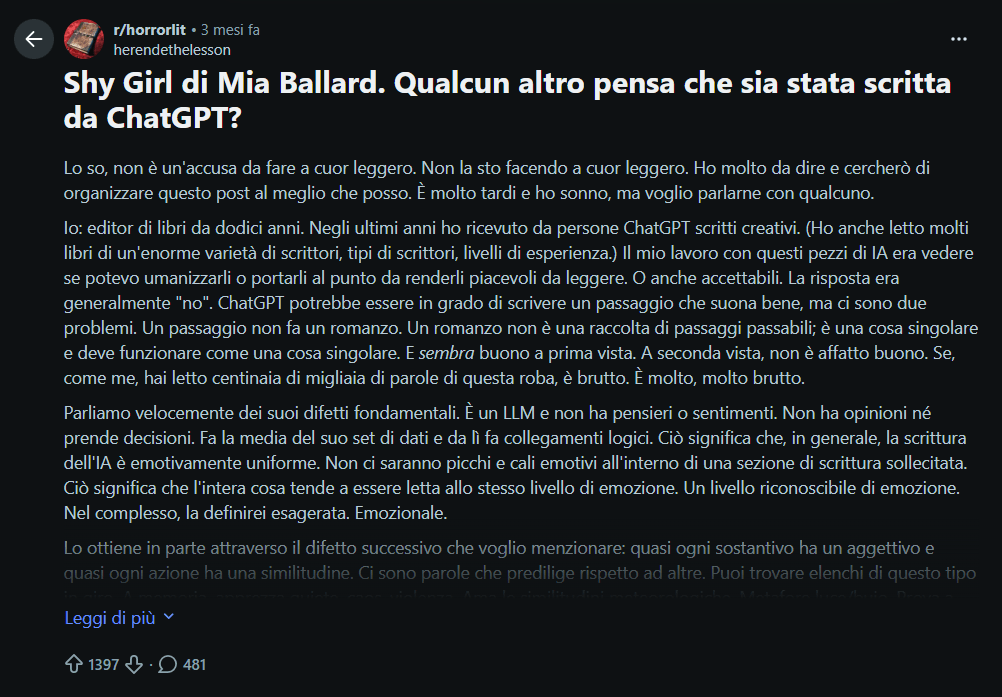

In parallelo, nascono dubbi nella community di lettori: tra Reddit e YouTube, alcuni iniziano a notare anomalie nel testo, come ripetizioni, strutture sintattiche ricorrenti, una certa “piattezza” stilistica percepita come artificiale.

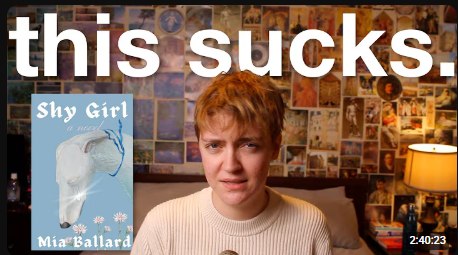

Nel gennaio 2026, su Reddit, un esperto dell’editoria sotto anonimato raccoglie queste osservazioni mentre un video-analisi della booktuber Frankie’s Shelf, pubblicato a febbraio, analizza il romanzo in modo sistematico, mettendo in dubbio la sua natura autoriale.

Frankie’s Shelf non è un’editor a sollevare il caso, ma una voce percepita come tale. In un ecosistema dove l’autorevolezza si costruisce nel tempo reale delle piattaforme, la competenza dichiarata può pesare quanto quella riconosciuta.

Questi segnali sono pubblici, visibili e ben argomentati. Eppure restano confinati nella community.

Il punto di svolta arriva quando il sospetto cambia scala.

Mentre il libro appare su tutte le piattaforme online e la campagna marketing continua a promuoverlo come nulla fosse, un’analisi condotta da un’azienda di AI detection, Pangram, attribuisce al testo una probabilità molto alta di essere generato artificialmente. Il dato del circola online, viene rilanciato, e infine entra nel circuito mediatico.

A questo punto – il 19 marzo – il New York Times riprende la notizia: nel giro di poche ore, ciò che prima era una discussione di nicchia diventa un caso editoriale globale.

Qui Hachette ritira il libro dalla pubblicazione, interrompe il progetto e diffonde una dichiarazione in cui ribadisce il proprio impegno verso la creatività umana.

La risposta è rapida, definitiva, perché la stessa casa editrice ha come policy quella di opporsi alla pubblicazione di testi generati da intelligenza artificiale.

Ma proprio questa rapidità solleva una domanda: perché intervenire solo ora?

Per scrivere questo articolo sono andata a ritroso, raccontandovi il momento in cui è sorto il dubbio nella comunità di lettori che avevano comprato e letto il libro.

I segnali c’erano già e le analisi – approfondite e ben argomentate – creator come Frankie’s Shelf circolavano da mesi. Ciò che cambia non è l’informazione, ma la sua legittimazione: il caso è diventato di dominio pubblico quando è stato ripreso dalla stampa.

È quando escono le accuse del New York Times che Mia Ballard le respinge. Inizialmente dichiara di non aver utilizzato l’intelligenza artificiale per scrivere il romanzo e sostiene che un collaboratore coinvolto nella fase di editing della versione autopubblicata potrebbe averne fatto uso senza il suo consenso. Aggiunge di essere in difficoltà, che la vicenda ha avuto un impatto diretto sulla sua vita e sulla sua reputazione, e che intende intraprendere azioni legali.

A questo punto, però, il danno è già avvenuto: emerge un sistema che reagisce, ma non previene.

Il caso Shy Girl non è solo una controversia sull’uso dell’AI. È un esempio di come funziona oggi il sistema culturale: la community individua i problemi, le piattaforme li amplificano, ma le istituzioni intervengono solo quando il caso diventa pubblico.

Chi legge, analizza, discute non ha strumenti per agire.

Chi potrebbe intervenire non lo fa finché non è costretto.

Dovrei restare imparziale, mi prefiggo di rimanere sempre neutra, ma non posso non provare una certa rabbia e impotenza verso chi avrebbe dovuto valutare in maniera più attenta quelle accuse. Ancora una volta, emerge un comportamento sistematico nei confronti del pubblico.

I lettori non sono stupidi e, benché le piattaforme online diano spazio anche a persone poco trasparenti nelle intenzioni, questo non giustifica il fatto di aver fatto orecchie da mercante. Il video di Frankie’s Shelf, come quello di altri, è esaustivo e analizza tutti i punti necessari per argomentare bene la propria tesi.

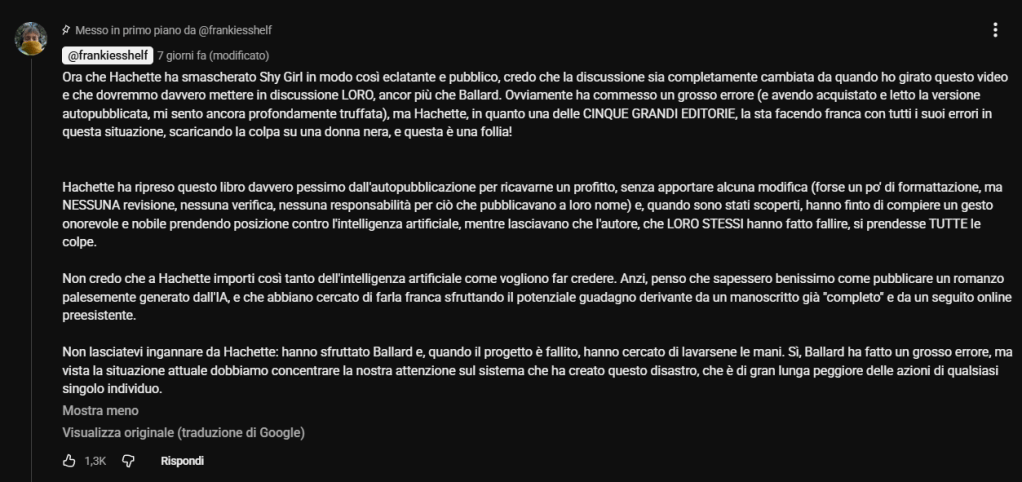

Pochi giorni fa, la stessa Frankie ha commentato sotto il suo video dichiarandosi sconvolta dalla vicenda e dal fatto che l’autrice sia diventata il principale bersaglio delle accuse.

Perché sì, negli sviluppi successivi, una parte della discussione si è concentrata quasi esclusivamente su Mia Ballard, messa al centro del dibattito come un capro espiatorio; negli ultimi giorni ha cancellato tutti i suoi profili social per questo motivo.

Eppure a me non basta.

Le cose sono quasi sempre più complesse di come vengono raccontate, e fermarsi alla superficie significa perdere tutto ciò che conta davvero.

Se un grande editore acquisisce un testo, lo revisiona, lo promuove e lo distribuisce, la responsabilità non può ricadere interamente sull’autore; soprattutto quando emergono problemi già segnalati in precedenza dalle stesse persone a cui quel libro è chiaramente destinato.

Come osservato anche da alcune persone, tra cui la stessa Frankie’s Shelf che aveva analizzato il libro mesi prima, il rischio è che il sistema scarichi le proprie contraddizioni sull’anello più debole della catena.

Ed è questo che spaventa davvero: oggi non esistono strumenti condivisi, affidabili e trasparenti per gestire situazioni come questa.

Mentre scrivo questo articolo, anche alcune realtà editoriali italiane come Pinguino Libri hanno segnalato un aumento significativo di manoscritti generati con l’AI; ho sempre più paura.

Il caso Shy Girl mostra un vuoto di protocolli, di standard e di responsabilità etica.

Non basta affidarsi alla reazione delle case editrici dopo che il danno è avvenuto o lasciare che siano le community a fare da filtro. E soprattutto, non basta che siano i singoli a pagarne le conseguenze.

Se l’intelligenza artificiale entra nei processi creativi, abbiamo bisogno di regole chiarissime: su uso, dichiarazione, verifica e responsabilità.

Devono essere le aziende che sviluppano queste tecnologie a intervenire, insieme ai governi e al settore editoriale, per definire protocolli etici e strumenti realmente applicabili. Regole che non possono essere lasciate alla discrezione dei singoli attori, perché nessuno di noi è ancora davvero pronto a gestire pienamente l’impatto dell’IA.

Questa assenza di strumenti non è solo teorica.

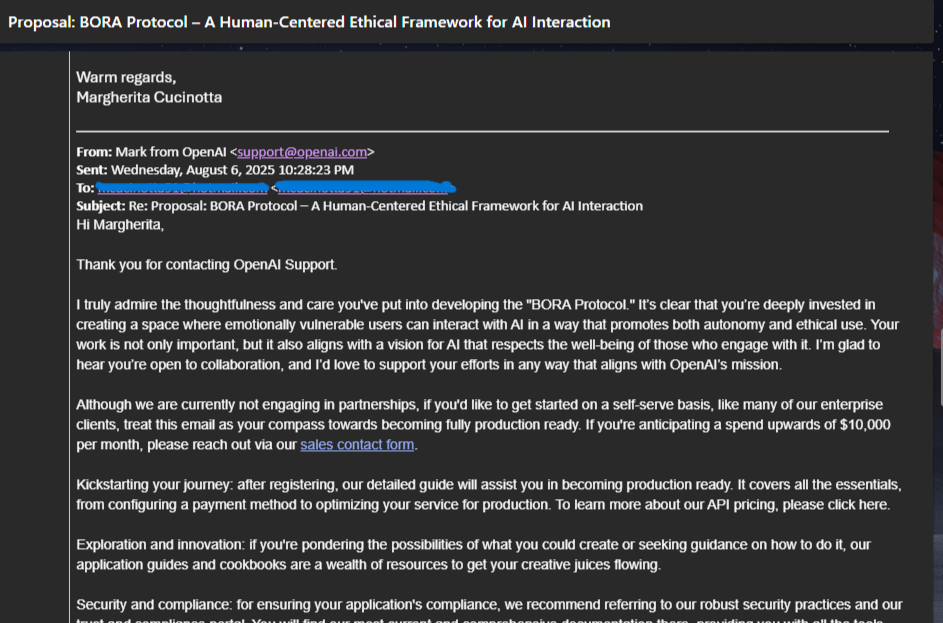

Un anno fa ho provato, nel mio piccolo, a proporre un protocollo etico sull’uso dell’IA – basato su terapia cognitivo comportamentale, terapia focalizzata sulle emozioni, disturbi dell’ansia e dell’umore, con presenza attiva di contradditorio, creando un “warning” di sicurezza nell’IA tra l’altro –, inviandolo direttamente alle aziende del settore.

La risposta ricevuta da una di loro – che vi mostro più in basso – è stata generata automaticamente e accompagnata dal suggerimento di avviare una campagna su Kickstarter. Non è il contenuto della risposta a colpire, bensì ciò che rivela: anche quando si prova ad aprire un dialogo, a chiedere aiuto, non esiste ancora un reale spazio di ascolto.

La realtà che ho toccato è questa: di fronte a questa innovazione, siamo di nuovo lasciati soli.

Ad oggi penso, e ne sono convinta, che le rivoluzioni accadano grazie a gruppi di persone uniti e compatti; eppure la narrazione occidentale continua a raccontarci il contrario, insistendo sull’idea che tutto cambi grazie a un singolo individuo.

Ma qui il problema è un altro. Il problema è che chi se n’era accorto non aveva il potere di intervenire, è chi di dovere ha scelto di ignorare quei segnali finché ha potuto. E quando ha capito di non poterlo più fare, era già troppo tardi.

Se il sistema interviene solo quando è costretto, e scarica tutto sull’anello più debole, allora la vera domanda è: di chi è davvero la responsabilità?

Articolo a cura di Margherita Cucinotta

Lascia un commento